- 登入

- 註冊

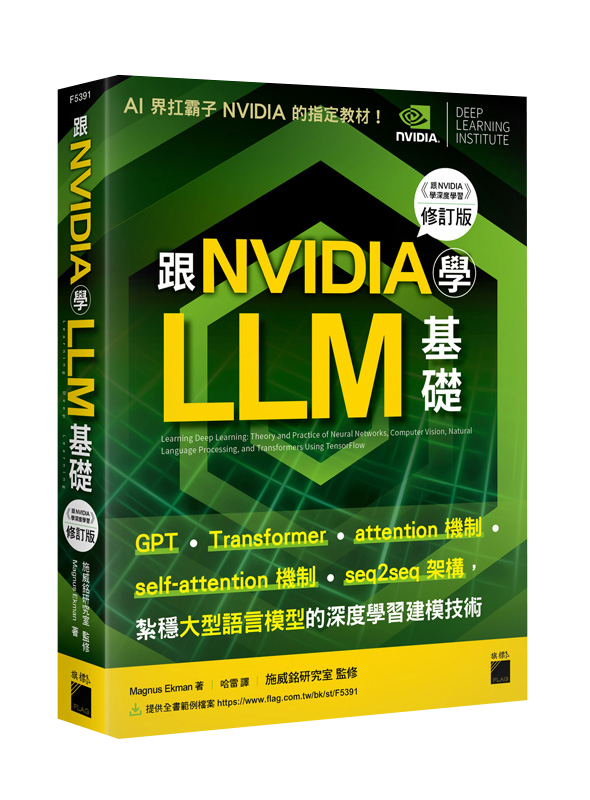

跟 NVIDIA 學 LLM 基礎!GPT、Transformer、attention、self-attention 機制、seq2seq 架構,紮穩大型語言模型的深度學習建模技術 (《跟 NVIDIA 學深度學習》修訂版)

NT$880

跟 AI 界扛霸子 NVIDIA 紮穩 LLM 基礎!

10 件庫存

-

▍GPT、Transformer、attention / self-attention 機制、seq2seq 架構…,大型語言模型 (LLM) 背後的建模技術「硬派」揭密!

▍AI 界扛霸子 NVIDIA 的指定教材!

近年來,在 NVIDIA (輝達) GPU、CUDA 技術的推波助瀾下,大型語言模型 (LLM) 的發展有著爆炸性的成長,例如最為人知的 ChatGPT 正是運用深度學習 (Deep Learning) 技術打造而成的熱門 LLM 應用。

□【★徹底看懂 LLM 核心建模技術 – GPT、Transformer 的模型架構】

自從 ChatGPT 爆紅之後,LLM 建模技術一直是熱門的研究話題,ChatGPT 的背後核心是 GPT 模型,而 GPT 裡面最重要的技術就是最後那個「T」- 也就是大名鼎鼎、使用了 attention (注意力) 機制的 Transformer 模型,這當中所用的建模技術可說是一環扣一環,也容易讓初學者學起來暈得不得了,只要一個關鍵地方沒搞懂,後面就全花了…

為此,本書經過精心設計,是帶你看懂 GPT、Transformer、attention…這些 LLM 關鍵技術的最佳救星!本書設計了「環環相扣」的 NLP 章節內容,循序漸進介紹 LLM 的基礎建模技術: